*Enterprise-IoT

*Smart Machine 사례연구

*Middleware 사례연구

*AI·Big Data 사례연구

*IoT 사례연구

*Smart Thinks 사례연구

*정부정책동향 사례연구

*K-SmartFactory

*Hidden Champion

*카드뉴스

*국내외 동향 리포트

S.A.R.A.는 인공 지능이 사회적 규범을 가질 수 있길 원한다.

-카네기 멜론의 가상 조력자에게 사회적 규범을 가르치기 위한 프로젝트.

이 모든 것은 오바마 대통령 연설에 관한 것도 아니고, 피츠버그 컨퍼런스에서 있었던 무인 자동차에 대한 생각도 아니다. : 리서치 프로젝트 역시 S.A.R.A.처럼 스포트라이트를 받았다. 가상의 조력자가 어떻게 사회적인 역할을 할 수 있는지 생각해왔다.

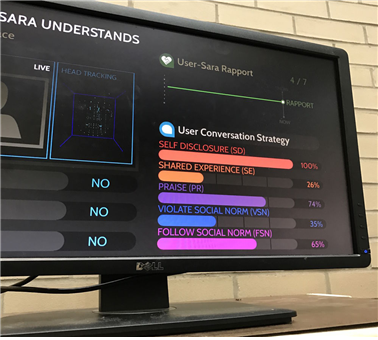

카메라와 마이크를 이용하여 S.A.R.A.는 당신의 질문을 들을 뿐만 아니라 당신의 기분이 어떤지도 상호작용을 통해 알아낼 수 있다. 미소를 띄고 하는 말과 얼굴을 찌푸리고 사회적 규범을 따르지 않는 행동을 하면 평범한 대답도 S.A.R.A.가 다르게 대답을 한다. “그녀는 당신의 행동과 그녀의 행동을 살필 것이다” 저스틴 카셀이 말했다. “그리고 그 행동에 대한 기본적인 상호작용을 예상한다. 이것은 그 전에는 그 누구도 하지 않았던 것이다.”

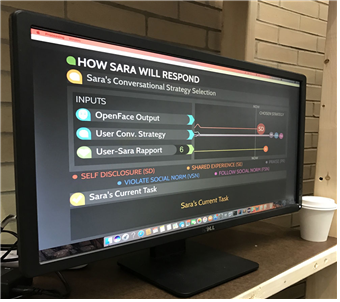

S.A.R.A. 프로젝트는 이전까지는 볼 수 없었던 3가지 요소로 구성되어있다고 카셀이 말했다 : 대화 전략 분류, 친밀한 평가자, 사회적 논리자. “대화 전략 분류은 5개의 세부적인 조직으로 분류할 수 있는데, 80%이상의 확률로 5개의 일상대화에서 쓰이는 단계를 분류할 수 있다.” 동시에 S.A.R.A.의 친밀한 평가자는 가상의 조력자 당신과 그녀가 얼마나 잘 따를 것인지 판단할 수 있다. “A.I 알고리즘 종류 중에 쓰이는 하나로 현재의 연관성 분석이라 불리는 완전 새로운 알고리즘이다.” 그 알고리즘은 실시간으로 작동하여 산출한다.

그러면 사회적 논리자는 “래포 단계에 기초하여 최근에 사용된 대화 전략과 비언어적인 행동으로 말하고자 하는 것을 결정한다.”이것이 S.A.R.A.의 미소를 띈 얼굴과 사회적 규범에서 오는 것까지 파악하는 능력이다.

번역: 김수진 선임연구원

편집: 김수진 선임연구원